Dalla gestione dell’infrastruttura storage alla gestione dei dati

Negli anni il modo di lavorare con i dati e di gestirli si sono costantemente evoluti tracciando percorsi sempre nuovi per affrontare varietà di requisiti in continuo cambiamento.

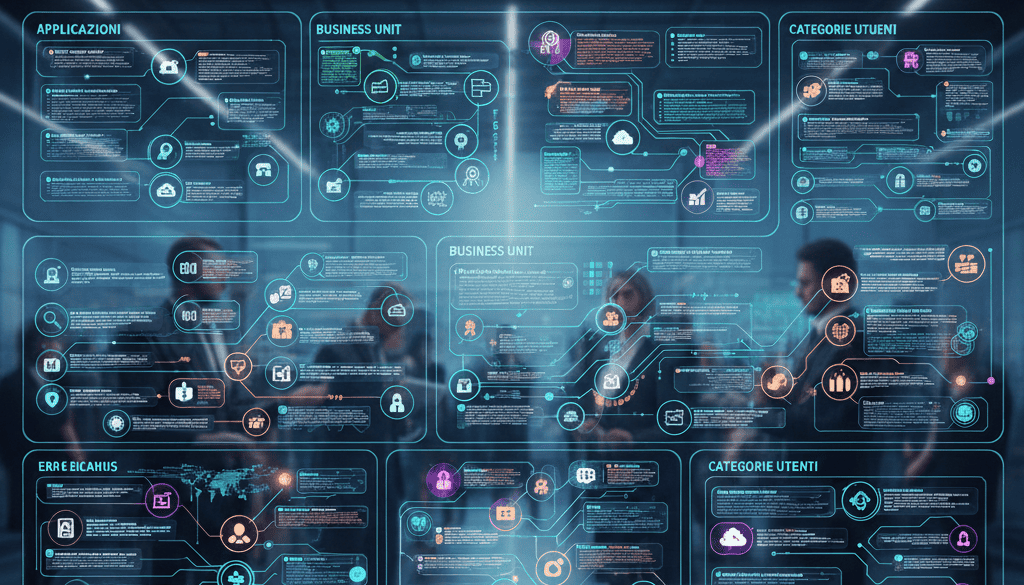

Database relazionali, data warehouse, data lake e adesso lakehouse, dati strutturati e non strutturati, in svariati formati, on-premises o in cloud pubblico, accessibili mediante numerosi protocolli differenti: la conseguenza per molte aziende è l’esistenza di decine di modi per gestire e utilizzare i dati a supporto di tutte le varie applicazioni, business unit e categorie di utenti.

L’introduzione di rigide regolamentazioni sui dati e una maggiore attenzione a resilienza, sicurezza e data governance hanno fatto sì che dover analizzare e rendere operativi questi dati rispettando requisiti normativi e policy interne sia diventato un compito estremamente complesso.

Il tutto avviene in un contesto di crescente diffusione dell’AI nelle aziende evoluzione che per mantenere le proprie promesse non solo richiede l’accesso ai dati in tutte le relative forme, ma genera anche a sua volta i propri dati che devono essere compresi, memorizzati e protetti.

Lo storage a silos è inefficiente, vulnerabile e costoso

Che ruolo ha lo storage in tutto questo? In molte realtà di grandi dimensioni, gli storage array on-premises restano ancora dedicati agli stack applicativi verticali, risultando non solo isolati ma anche gestiti indipendentemente array per array.

In genere esistono ottime ragioni tecniche ed organizzative per mantenere questa modalità operativa; il risultato tuttavia è la frammentazione e la separazione di dati e gestione in silos che non sono solamente inefficienti e costosi (dal momento che possono spesso condurre a un utilizzo parziale delle risorse), ma che possono anche ostacolare l’accesso o la movimentazione dei dati.

Si crea così una situazione nella quale i volumi dei dati aumentano e, allo stesso tempo, diventano sempre più inaccessibili, difficili da gestire e vulnerabili ai rischi di compliance e alle cyber-minacce. Tutto questo perché, essendo associati a specifiche applicazioni, i dati ne restano in qualche modo “prigionieri” senza altro modo per raggiungerli se non passando attraverso le loro applicazioni native o, in alternativa, copiandoli per poi spostarli.

Sviluppatori, data scientist e utenti hanno bisogno di lavorare sui dataset per creare e modificare applicazioni, generare in tempo reale report e analytics, ecc… Senza la possibilità di lavorare sui dati in un unico ambiente, non resta altro che copiarli dove è più facile utilizzarli. Si tratta di una pratica comune che mette i dati al di fuori della portata delle altre applicazioni e che non rispetta le best practice di governance. La conseguenza: molteplici copie che sfuggono alla visibilità e al controllo dell’azienda, poiché restano al di fuori della sfera della governance e della protezione.

Se l’accesso ai dati viene richiesto da un’applicazione diversa da quella per cui è stato eseguito il provisioning dello storage array e dei suoi volumi, ecco che scatta un complicato processo che aggiunge ulteriore appesantimento alla gestione dello storage e che introduce la possibilità di indesiderabili migrazioni di dati.

In breve, la consueta associazione di storage array a specifici stack applicativi genera silos di dati isolati da una parte e proliferazione incontrollata e ingovernabile dei dati dall’altra.

Le conseguenze si fanno quindi sentire in termini di maggiori costi per la gestione e la capacità storage, maggiori livelli di vulnerabilità alle cyber-minacce a causa dell’ampliamento della superficie di attacco, e un patrimonio di dati aziendali più difficile da poter raggiungere per ricavarne insight mediante analytics e AI.

Gli hyperscaler hanno tracciato la strada?

Viene da pensare a quanto diversamente da tutto questo funzionino le cose nel cloud, e in particolar modo tra gli hyperscaler. In ambienti di quel genere lo storage viene astratto e la capacità raggruppata in pool dai livelli (o tier) prestazionali differenti, mentre la gestione è affidata a un control plane unificato. Un’architettura che semplifica certamente il consumo della capacità da parte dei clienti degli hyperscaler, ma che rende anche estremamente efficiente l’utilizzo delle risorse per gli hyperscaler stessi.

Indipendentemente da ciò, la sfida resta quella di introdurre nel mondo enterprise modelli operativi basati su astrazione e aggregazione delle risorse, oltre che passare dalla gestione dello storage alla gestione dei dati affinché, al posto di dover amministrare sistemi storage individuali, lo storage sia gestito sotto forma di flotta unificata in modo coerente e intelligente nell’intero ambiente. Questo permette che le aziende possano comprendere e utilizzare i dataset indipendentemente dall’hardware sottostante.

Tre fondamenta: astrazione, policy, API

La prossima evoluzione nei data center aziendali sarà quella che porterà a un cloud virtualizzato di dati simile a quello appena descritto. La chiave che lo consentirà sarà formata dalla giusta tecnologia storage e da software intelligente in grado di sfruttare tutte le risorse sotto il suo controllo e di rendere possibile il cosiddetto “modello operativo cloud”.

Un data cloud virtualizzato necessita di un control plane unificato con capacità di governance e gestione dei dati autonome e intelligenti sull’intero sistema informativo, si trovi esso on-premises piuttosto che nel cloud pubblico o in entrambi i tipi di ambiente.

Pilotato via API e basato su policy, questo data cloud virtualizzato prevede provisioning self-service, uniformità delle operazioni, integrazione con l’intero scenario applicativo, facilità di governance indipendentemente dalla scala del sistema informativo ed eliminazione dei silos esistenti. Si confronti tutto ciò con una realtà ancora molto diffusa nella quale la gestione viene effettuata array per array e le operazioni sono tutte manuali.

Sul lato hardware, capacità e prestazioni devono poter scalare dinamicamente in modo trasparente senza interruzioni operative, degrado delle performance o inutili migrazioni di dati. La soluzione deve inoltre consentire all’azienda di offrire classi di servizio diversificate in linea con differenti policy di prestazioni, resilienza, sicurezza e conformità e che possano essere facilmente utilizzate da applicazioni, business unit e clienti interni, il tutto orchestrato da un control plane distribuito.

I dati possono essere quindi condivisi, copiati e distribuiti facilmente in maniera automatica, efficiente e basata su policy, in linea con i requisiti delle applicazioni moderne e delle casistiche di utilizzo dell’AI.

Come rispondere alla sfida

Finora un solo approccio architetturale è stato capace di vincere questa sfida: l’Enterprise Data Cloud (EDC) di Pure Storage.

L’EDC combina diversi pilastri funzionali fondamentali di Pure Storage per creare un data plane unificato in grado di fornire un’esperienza coerente su blocchi, file e oggetti attraverso l’intera flotta storage del cliente a fianco di servizi dati avanzati come snapshot, replica, alta disponibilità multi-sito e funzioni anti-ransomware.

Queste capacità derivano da Purity, l’ambiente operativo presente su tutti i modelli di array Pure Storage. In aggiunta, il layer di monitoraggio Pure1 Alops fornisce insight intelligenti e ottimizzazione a livello di flotta.

Lo stack prosegue con un control plane unificato per storage pool con differenti classi di dati gestiti via policy grazie a Pure Fusion, che consente il provisioning dei dati secondo il profilo del workload spostandoli come richiesto tra classi storage compatibili. Ciò permette una gestione dei dati focalizzata su policy, automazione e API anziché su operazioni manuali e gestione array per array.

Infine, Pure Storage sfrutta le capacità as-a-service della sua architettura Evergreen per consentire ai clienti di ampliare e aggiornare l’intera flotta storage senza interruzioni operative, garantendo che resti sempre all’avanguardia e costantemente aggiornata.

Il percorso che ci attende

L’Enterprise Data Cloud di Pure Storage risolve le sfide dello storage frammentato in silos unificando la gestione dei dati sullo storage a blocchi, a file e a oggetti. Grazie ad automazione policy-driven, insight intelligenti e scalabilità trasparente, l’EDC trasforma l’infrastruttura storage in una piattaforma AI-ready software-driven che garantisce agilità, governance ed efficienza operativa. In breve, l’intenzione è quella di fare in modo che i clienti possano smettere di gestire lo storage per iniziare a gestire i dati.

Umberto Galtarossa, Sr. Systems Engineering Manager, Pure Storage Italy